Chaque année, environ 7 millions d'enfants sont signalés aux autorités de protection de l'enfance pour de possibles abus, mais comment les autorités déterminent-elles si les enfants aiment Gabriel Fernandez sont en grave danger et ont besoin d'une intervention?

De nombreuses autorités de protection de l'enfance se fondent sur les évaluations des risques données par des membres du personnel formés pour gérer les lignes téléphoniques là où des soupçons d'abus sont signalés, mais certains pensent qu'il peut y avoir un meilleur moyen.

les collines ont des yeux histoire vraie

«Il existe un large corpus de littérature que nous avons vu suggérer que les humains ne sont pas particulièrement de bonnes boules de cristal», Emily Putnam-Hornstein, directrice de la Réseau de données pour enfants et professeur agrégé à l'USC, a déclaré dans la nouvelle série de documents Neflix «Les essais de Gabriel Fernandez». 'Au lieu de cela, ce que nous disons est de former un algorithme pour identifier lequel de ces enfants correspond à un profil où le risque d'arc long suggérerait une future implication du système.'

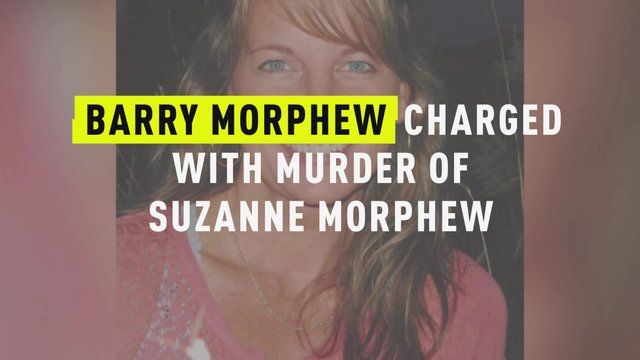

Fernandez était un garçon de 8 ans battu et torturé à mort par son mère et elle petit ami , malgré les appels répétés de son professeur et d’autres aux autorités pour signaler des soupçons d’abus. La nouvelle série en six parties examine la vie et la mort horrible de Fernandez, mais elle jette également un regard plus large sur problèmes systémiques au sein du système de protection de l’enfance qui aurait pu jouer un rôle.

Putnam-Hornstein soutient qu'une stratégie pour identifier plus efficacement les enfants les plus à risque pourrait être d'utiliser des algorithmes spécialement créés qui utilisent des dossiers administratifs et l'exploration de données pour déterminer les scores de risque pour chaque enfant.

«Nous avons en fait environ 6 ou 7 millions d'enfants qui sont signalés pour des allégations de maltraitance ou de négligence chaque année aux États-Unis et, historiquement, la façon dont nous avons pris certaines de nos décisions de dépistage est simplement basée sur des types d'évaluations intestinales», a-t-elle déclaré. 'La modélisation prédictive des risques consiste simplement à dire:' Non, non, non, adoptons une approche plus systématique et empirique à ce sujet. ''

Putnam-Hornstein et Rhema Vaithianathan, codirecteur de la Centre d'analyse des données sociales , ont pu mettre l'idée en pratique dans le comté d'Allegheny, en Pennsylvanie. Le couple a utilisé des milliers de références pour maltraitance d'enfants pour concevoir un algorithme qui déterminerait un score de risque pour chaque famille signalée aux services de protection de l'enfance du comté, selon le Centre de journalisme de santé .

Peterson a assassiné sa femme à Durham, en Caroline du Nord

«Il y a une centaine de facteurs différents qui sont examinés», a expliqué Marc Cherna, directeur du département des services à la personne du comté d'Allegheny, dans la série documentaire. «Certains exemples de base sont les antécédents de protection de l'enfance, les antécédents des parents, certainement la consommation de drogues et la toxicomanie, la maladie mentale familiale, la prison et les condamnations, et surtout s'il y a des agressions et des choses comme ça.

En raison du grand nombre d'appels, les autorités de protection de l'enfance de tout le pays sont chargées de déterminer si une famille doit être présélectionnée pour une enquête sur la base de la plainte ou si elle doit être exclue.

En 2015, 42% des 4 millions d'allégations reçues à travers le pays concernant 7,2 millions d'enfants ont été éliminées, selon Le New York Times .

Pourtant, des enfants continuent de mourir de maltraitance.

Le système utilisé dans le comté d'Allegheny est conçu pour prédire avec plus de précision quelles familles sont susceptibles d'avoir une implication future dans le système grâce à l'analyse des données.

'Ce que les contrôleurs ont, c'est beaucoup de données', a déclaré Vaithianathan au Times. «Mais il est assez difficile de naviguer et de savoir quels facteurs sont les plus importants. En un seul appel à C.Y.F. , vous pourriez avoir deux enfants, un auteur présumé, vous aurez maman, vous pourriez avoir un autre adulte dans le ménage - toutes ces personnes auront des antécédents dans le système sur lesquels la personne filtrant l'appel pourra enquêter. Mais le cerveau humain n’est pas si habile à exploiter et à donner un sens à toutes les données. »

L'outil de dépistage familial Allegheny utilise une technique statistique appelée «exploration de données» pour examiner les modèles historiques afin «d'essayer de faire une prédiction sur ce qui pourrait arriver» dans un cas donné, a-t-elle déclaré dans la série documentaire.

salvatore «sally bugs» briguglio

Chaque cas se voit attribuer un score de risque allant de un à 20 - classant chaque cas comme étant à haut risque, à risque moyen ou à faible risque.

Rachel Berger, pédiatre à l'hôpital pour enfants de Pittsburgh, a déclaré au Times en 2018 que ce qui rend l'analyse prédictive précieuse, c'est qu'elle élimine une partie de la subjectivité qui entre généralement dans le processus.

«Tous ces enfants vivent dans le chaos», dit-elle. «Comment C.Y.F. choisir ceux qui sont le plus en danger lorsqu'ils présentent tous des facteurs de risque? Vous ne pouvez pas croire à la quantité de subjectivité qui entre dans les décisions de protection de l’enfance. C’est pourquoi j’adore l’analyse prédictive. Cela apporte enfin un peu d’objectivité et de science à des décisions qui peuvent changer la vie de façon incroyable. »

Mais il y a également eu des critiques qui soutiennent que l'utilisation de l'analyse prédictive repose sur des données qui peuvent déjà être biaisées. Des recherches antérieures ont montré que les minorités et les familles à faible revenu sont souvent surreprésentées dans les données collectées, créant potentiellement un biais contre les familles afro-américaines ou d'autres familles minoritaires, selon la série documentaire.

«Les préjugés humains et les biais de donnéesaller de pair les uns avec les autres», A déclaré Kelly Capatosto, associée principale de recherche à l'Institut Kirwan pour l'étude de la race et de l'ethnicité à l'université de l'État de l'Ohio, selon le Center for Health Journalism. «Avec ces décisions, nous pensons à la surveillance et au contact avec le système - avec la police, les agences de protection de l'enfance, toutes les agences d'aide sociale. Il sera surreprésenté dans les communautés (à faible revenu et minoritaires). Cela n’indique pas nécessairement l’endroit où se déroulent ces instances. »

Erin Dalton, directrice adjointe du bureau d’analyse, de technologie et de planification du comté d’Allegheny, a reconnu que la partialité était possible.

combien de films poltergeist y a-t-il

«Bien sûr, il y a des préjugés dans nos systèmes. La maltraitance des enfants est considérée par nous et nos données ne sont pas une fonction de la maltraitance réelle des enfants, c'est une fonction de qui est signalé », a-t-elle déclaré dans la série Netflix.

Mais le comté a également déclaré au Center for Health Journalism qu'il avait constaté que le fait de recevoir des prestations publiques réduisait les scores de risque pour presque avoir de ses familles.

TLe comté est «très sensible» à cette préoccupation et procède actuellement à une analyse du système pour déterminer si des groupes ont été ciblés de manière disproportionnée, a également déclaré Cherna dans la série de documents.

Le système du comté d'Allegheny appartient au comté lui-même, mais il y a également eu des critiques à l'égard d'autres systèmes de dépistage privés.

Le département des services à l'enfance et à la famille de l'Illinois a annoncé en 2018 qu'il n'utiliserait plus un package d'analyse prédictive développé par Eckerd Connects, une organisation à but non lucratif, et son partenaire à but lucratif MindShare Technology, en partie parce que la société a refusé de fournir des détails sur les facteurs. étaient utilisés dans leur formule, selon le Times.

Le système aurait commencé à désigner des milliers d'enfants comme ayant besoin d'une protection urgente, donnant à plus de 4100 enfants de l'Illinois une probabilité de décès ou de blessure de 90% ou plus, Le Chicago Tribune rapporté en 2017.

Pourtant, d'autres enfants qui n'ont pas obtenu de scores de risque élevé ont quand même fini par mourir d'abus.

'L'analyse prédictive (ne prévoyait) aucun des mauvais cas', a déclaré Beverly «B.J.», directrice du Département des services à l'enfance et à la famille. Walker a dit à la Tribune. «J'ai décidé de ne pas conclure ce contrat.

Daniel Hatcher, auteur de « L’industrie de la pauvreté: l’exploitation des citoyens les plus vulnérables d’Amérique »A comparé certains des systèmes analytiques à une« boîte noire », affirmant dans la série documentaire que la manière dont ils prennent leurs décisions n'est pas toujours claire.

femme qui a accusé tupac de viol

«Ils n'ont aucun moyen de déterminer comment ils décident réellement d'un niveau de soins qui a un impact énorme sur un individu», a-t-il déclaré.

Putnam-Hornstein a reconnu que les systèmes d'analyse prédictive ne sont pas en mesure de déterminer le comportement futur, mais elle pense que c'est un outil précieux qui permet aux contrôleurs de prendre des décisions plus éclairées sur les enfants qui courent le plus de risques.

«J'espère que ces modèles aideront notre système à accorder plus d'attention au sous-ensemble relativement restreint de renvois où le risque est particulièrement élevé et que nous serons en mesure de consacrer davantage de ressources à ces enfants et familles de manière préventive», a-t-elle déclaré, selon au Center for Health Journalism. «Je ne veux pas que quiconque vende à l'excès la modélisation des risques prédictifs. Ce n’est pas une boule de cristal. Cela ne résoudra pas tous nos problèmes. Mais à la marge, si cela nous permet de prendre des décisions légèrement meilleures et d'identifier les cas à haut risque et de les trier des cas à faible risque et de les ajuster en conséquence, cela pourrait être un développement important sur le terrain.